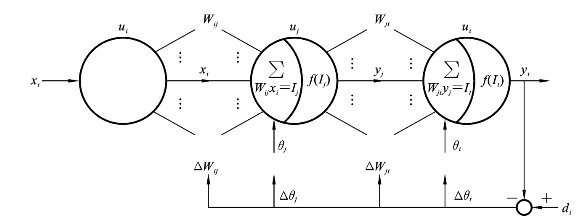

前向网络是目前研究最多的网络形式之一,如图8.2.2所示,它包含输入层、隐含层及输出层。隐含层可以为一层或多层。每层上的神经元称为节点或单元。

图8.2.2 BP网络结构及反向学习原理

各层神经元之间的连接强度用连接权重Wij表示。Wij表示输入层第i单元与隐含层第j单元之间的连接强度。各单元的输出取决于前一层单元的输出及相应的连接权重,并由式(8.2.1)决定。网络的“知识”表现为网络中的全部权重Wij,它可以通过样本的“训练”达到。“训练”就是一种学习。给定样本就是给定一个输入向量X=(x1,x2,…,xn)及期望输出向量Y=(y1,y2,…,yq)。“训练”就是按照实际输出最接近期望输出的原则,来修改全部连接权值Wij。计算实际输出是按向前计算的方向来进行的(即由输入至输出方向进行),而修改权重Wij则是按反向进行的(即由输出至输入方向进行的),因此称为反向传播网络(back-propagate network),简称BP网络。

在这种网络中,“训练”时要先给定输入向量X及期望输出Y,这就好比有教师在“训练”中提供样板数据(样本)。网络学习时是基于“奖惩”式规则,即根据教师提供的数据来调整权重,当网络回答正确时,调整权重朝强化正确(即奖励)的方向变化,当网络响应错误时,调整权重往弱化错误(即惩罚)的方向变化。因此BP网络也称为有教师学习网络。

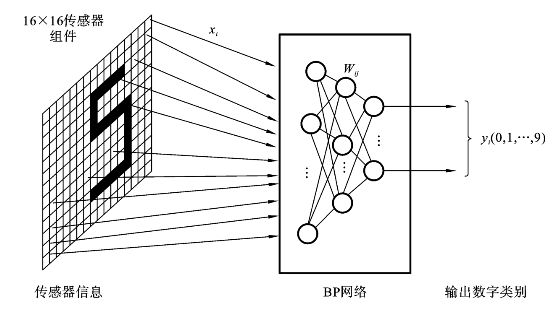

为了更清楚地说明上述网络的作用,下面列举一手写数字识别的例子,如图8.2.3所示,用16×16的传感器阵列来记录手写体数字:每一传感器对应字板上的一个小方块,传感器记录对应的小方块上有无墨迹,有墨迹为“1”,无墨迹为“0”。传感器阵列信息传送给BP网络的输入层,相应的输入层便有256个单元。信息通过隐含层送到输出层输出。输出层有10个单元,对应10个数字。隐含层由设计者自定,各层之间的信息传递强度用权重Wij表示,各单元的输出取决于该单元的输入与权重的乘积之和。所以网络的“识别知识”便完全由权重Wij所决定。

图8.2.3 手写数字识别网络原理图

训练时,先手写一个数字(例如5),要求期望的输出为dt(其中dt5=1,而其余的dt=0)。任意给定初始权重,从网络上可以算出yt(1)(第一次计算的输出),比较yt(1)与期望输出dt,求得误差值et,按“奖惩”原则,从输出层到输入层逐个调整连接权重Wij,以减小误差,对每种数字的多种不同图像重复训练,直到网络能对每个手写数字正确归类为止。

BP算法的过程可以分成两个阶段。第一阶段是由输入层开始逐层计算各层神经元的“净输入”sj和输出yj直到输出层为止,这一阶段称为模式前向传输。第二阶段是由输出层开始逐层计算各层神经元的输出误差,并根据误差梯度下降原则来调节各层的连接权重Wij及神经元的阈值θj,使修改后的网络的最终输出yt能接近期望值dt,亦即误差et会减小,这一阶段称为误差反向传播。在一次训练以后,还可重复训练,使输出误差更小,直到满足要求为止。

1)模式前向传输

设输入向量为X=(x1,…,xi,…xn),期望的输出向量为D=(d1,…,dt,…dq)。

在图8.2.4中,将各层网络中的任意神经元的连接单独表示出来以便计算。图中ui,uj,ut分别为输入层、隐含层、输出层的任意单元。

图8.2.4 BP网络中的任意单元连接

输入层各单元ui只纯粹传送输入信息,不起其他作用。

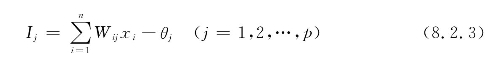

(1)计算隐含层各单元的“净输入”I j。

式中:Wij是输入层第i单元与隐含层第j单元间的连接权重;θj是隐含层第j单元的阈值;p是隐含层单元总数。(https://www.xing528.com)

(2)用S型函数计算隐含层各单元的输出yj。

式中:yj是隐含层第j单元的输出。

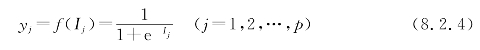

(3)计算输出层各单元的“净输入”It。

式中:Wjt是隐含层第j单元与输出层第t单元之间的连接权重;θt是输出层第t单元的阈值;q是输出层单元总数。

(4)计算输出层各单元的实际输出yt。

![]()

式中:yt是输出层第t单元的实际输出。

2)误差反向传播

由于期望输出dt与实际输出yt不一致,因而产生误差,通常用方差来表示这一误差:

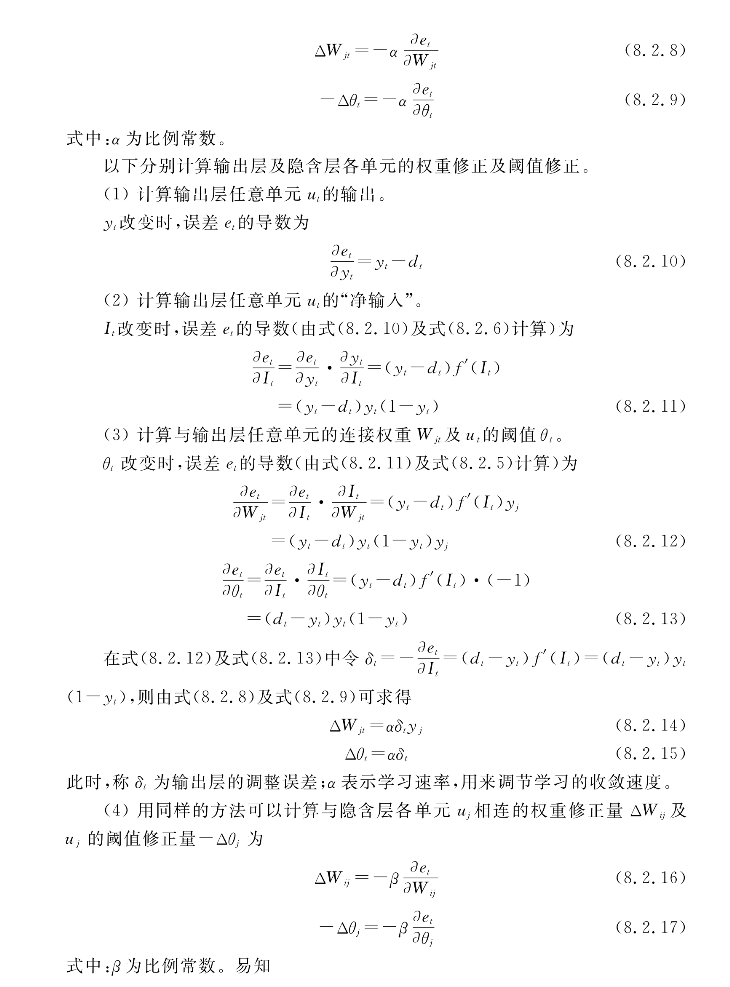

按照误差e来修改输出层的权重Wjt和阈值θt。权重Wjt和阈值θt的修改应使et最小,因此Wjt和θt应沿et的负梯度方向变化,即修正量ΔWjt及Δθt应与(∂et/∂Wjt)及(∂et/∂θt)成正比,即

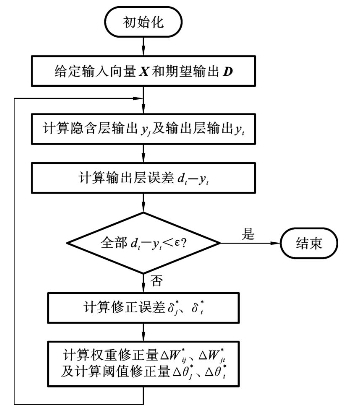

图8.2.5 BP算法流程图

BP算法是一个很有用的算法,因此受到广泛的重视,但也存在一些缺点。缺点主要表现为:存在局部极小值问题;算法收敛速度很慢;新加入的样本会影响已学完样本的学习结果;选取隐含单元数目尚无指导原则。有人证明两层隐含可以作成任意复杂的判决界面,隐含层数越多学习功能越强,但学习速率会下降。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。