现今信息熵的概念被广泛应用,那么什么是熵呢?

设某一实验可能有N种结果,每项结果出现的概率分别为p1,…,pN。如果事先告诉你将会出现第i种结果的信息,其信息量为-log2pi,而该实验的不确定性则可用这组信息的平均信息量(熵)来表示平均信息量即为熵。

例5 投掷一枚骰子的结果有6种,即出现1~6点。出现每种情况的概率均为1/6,故熵为

![]()

投掷一枚硬币的结果有正反面两种,出现的概率均为 ,故熵为

,故熵为

![]()

向一块大石头上猛摔一枚鸡蛋,其结果必然是将鸡蛋摔破,这种结果出现的概率为1,故熵为

![]()

从上面的例子可以看出,熵实际上反映的是问题的“模糊度”,熵为零时,问题是完全清楚的,熵越大则问题模糊度越大。

离散型概率分布的随机试验,熵的定义为

![]()

连续型概率分布的随机试验,熵的定义为

![]()

定理2 若试验仅有有限个结果S1,…,SN,其发生的概率分别为p1,…,pN,则当

![]()

时,此试验具有最大熵。

此定理可以化为条件极值问题来证明(读者可以自行完成)。

定理3 若试验是连续型随机试验,其概率分布p(x)在[a,b]区间以外均为零,则当p(x)平均分布时具有最大熵。

定理4 对一般连续型随机试验,在方差一定的前提下,正态分布时具有最大熵。

定理5 最大熵原理,即受到相互独立且均匀而小的随机因素影响的系统,其状态的概率分布将使系统的熵最大。

上述结果并非某种巧合,根据概率论的中心极限定理,若实验结果受到大量相互独立的随机因素的影响,且每一因素的影响均不突出时,实验结果服从正态分布。最大熵原理则说明,自然现象总是由不均匀逐步趋于均匀的。在不加任何限制的情况下,系统将处于熵最大的均匀状态。这个原理被广泛应用。

例6 有12个外表完全相同的硬币,已知其中有一个假币,其重量可能比真的轻些,也可能重些。现要求用没有砝码的天平在最少的次数中找到假币,问应当怎么称?

解 假币可轻可重,每一枚硬币都可能是假币。故此问题具有24种情况。每种情况的概率为 ,所以此问题的熵为log224。现在确定最少次数的下界。

,所以此问题的熵为log224。现在确定最少次数的下界。

实验最多出现3种结果,根据定理2,这种实验在可能出现的各种事件具有相等的概率时,所提供的平均信息量最大,故实验提供的平均信息量不超过log23。

设最少需要k次找出假币,则这k次实验提供的总信息量不超过k log23=log23k。而问题的模糊度(熵)最小为log224。由必要条件log23k≥log224,得k≥3。那么,称3次足够了吗?

实验方法:使每次实验提供尽可能大的平均信息量。

将12枚硬币平均分成3堆,取2堆放在天平上称,出现两种情况。

(1)情况1 两堆重量相等

假币在未称的4枚中,任取其中的3枚,加上从已经称过的8枚中任取1枚,平均分为2堆来称,又会出现两种情况。

①两堆重量相等

最后剩下的1枚是假币。再称一次确定其是比真币轻还是比真币重。

②两堆重量不相等(https://www.xing528.com)

假设右重左轻,并且真币在左边。若假币在右边,则说明假币比真币重;若假币在左边,则说明假币比真币轻。取右边2枚硬币再称一次即可找到假币。

(2)情况2 两堆重量不相等。

设右边硬币较重。先从左边取出2枚放在旁边,再将右边的取出2枚放在左边,将原来左边剩下的2枚中取出1枚放到右边,又会出现两种情况。

①两堆重量相等

从左边取出的2枚中轻的那枚为假币,再称一次即可找到假币。

②两堆重量不相等。

若右边硬币较重,则假币在右边原来的2枚及左边未动过的1枚中(若为前者,则假币偏重;若为后者,则假币偏轻),于是再称一次即可找到假币。若左边硬币较重,则假币必在交换位置的3枚中,可类似区分真伪。

因此,称3次是最小的次数。

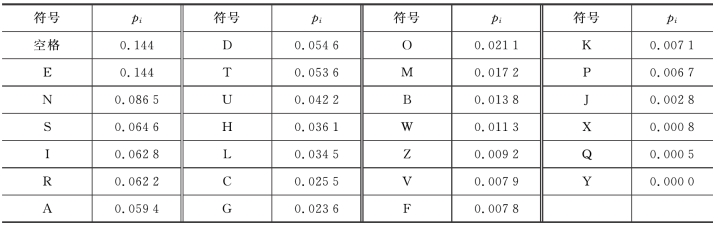

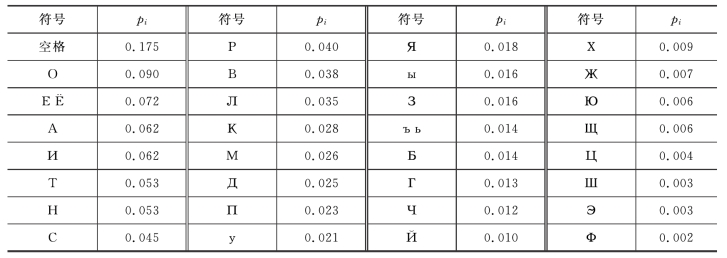

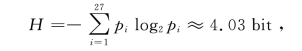

例7 计算英文的熵。在人类活动中,大量信息是通过文字或语言来表达的,而文字或语言则是一串符号的组合。据此,我们可以计算出每一种语言中每一个符号的平均信息量。例如,表3.1、表3.2和表3.3分别是英语、德语和俄语中每个符号(字母与空格,不包括标点符号)在文章中出现的概率的统计结果(汉语因为符号繁多,尚没有统计结果)。

表3.1 英语中每个符号在文章中出现的概率

表3.2 德语中每个符号在文章中出现的概率

表3.3 俄语中的每个符号在文章中出现的概率

以计算英文的多余度为例,可得

对于有27个符号的信息源,可能达到的最大信息量为

Hmax=log227≈4.75 bit

由此可以计算出英文表达的多余度为

![]()

事实上,英语在表达意思上的确存在着富余。例如,Q后面出现U的概率几乎为1,T后面出现H的概率也很大。这种多余是完全必要的,没有多余度的语言是死板的,没有文采的,它是存在语法的必要条件。但对于电报编码、计算机文字处理等而言,这种多余度的存在常常造成浪费。有人在上述讨论的基础上研究了符号编码的问题,即每一个符号的平均信息量达到十分接近Hmax的程度,但由于译码过于复杂,这种方法尚未在实际中使用。

例8 赌球的庄家总是稳赚不赔。

“赌球的庄家总是稳赚不赔”这句话是真的,其中也没有什么奥秘,从信息论的角度来看,这个问题就是信息熵的计算问题。

问题:猜一猜,有32支足球队参加世界杯赛,冠军是哪一支?假如我们能提前确定各个球队获得世界杯冠军的概率,设定它们分别是p1,p2,…,p32。那么我们套用公式,就可以算出这件事需要多少信息,或者说这个问题的信息量是多少。我们假定算出的信息量为3.4 bit,或者说对应于3.4元钱。如果一个人提一次问题支付1元钱,从理论上讲,所有参加赌局的人只要平均每人支付3.4元就能得到谁是冠军这个信息。但是如果设定赌局的人将收费标准略微提高到平均每人4元。这里面的盈余就被设赌局的人拿走了。

我们怎么才能提前知道概率?即每个球队赢得冠军的概率是如何被预估的?其实这是下注的人“告诉”设赌局的人的。

如果大家都押德国队获胜,结果预测德国获冠军的概率就很高,所以押注的多少其实就是大家给出的概率。而开赌局的人,只要收费比信息实际的价值高,就是稳赚不赔的。另外,开赌局的人从来不与赌客赌,而是让赌客们彼此互相赌,他通过变相收费来盈利。

例9 理财的真相。看过上面的例子,很多人会认为,只要不参加赌局,就不会被开设赌局的人把钱赚走。其实上述这类赌局在金融市场更多。

很多人听说过“结构化的投资证券”(Structured Notes),比如说,石油的价格上涨到100美元以上,每高出1美元高盛集团(一家国际领先的投资银行)就付给你1.5美元,但是,如果没有到100美元,你需要每个月付1美元给高盛。这种投资工具,就被做成一种结构化的投资证券。

航空公司或者运输公司由于担心油价浮动太高,因此会购买这样的投资产品。那么是高盛在和石油公司,或者其他人赌吗?不是的,高盛转手就将和它完全相反的投资产品卖给了希望油价波动的人。当然,高盛会包装得很好,让两边都感谢它,其实它才是真正盈利的一方。

金融数学的专业人才常做的事情就是设计这类不容易为人所看懂,而自己永远不会赔钱的金融产品。很多基金经理,就是把这样的产品卖给理财的人,因此,多了解信息论和基本的数学常识,可以在生活中省下不少冤枉钱。很多交易和产品都是利用了信息的可度量性,知道了这点,就可以看清很多复杂交易背后的原理。

掌握了信息量化度量的原理,我们还可以用它来对付当今“信息过载”的问题,比如,如何判断一篇报道里到底有多少信息量。

总之,信息是用于消除不确定性的。如果一篇文章中叙述的大部分事情大家都知道,信息量就很少。这也是为什么大家不愿意读那些被称作心灵鸡汤的文章的原因,并非是它们的内容不正确,而是它们没有信息量。和它们相反的是,历史上有些足以改变世界的论文,它们非常短小,但是信息量巨大。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。