如图4-14所示,局部二值模式的行为特征提取是基于耦合二值特征学习的RGB-D行为识别中一个最关键的阶段,由两个重要的部分组成:一是设计高效的3D像素差向量计算方法,二是根据计算得到的像素差向量进行无监督二值编码学习。下面分别从3D像素差向量、耦合二值特征学习的目标函数建立以及求解三个方面对本节内容进行介绍。

图4-14 基于耦合二值特征学习的RGB-D行为识别框架(实线框部分为本文创新部分)

1.3D像素差向量

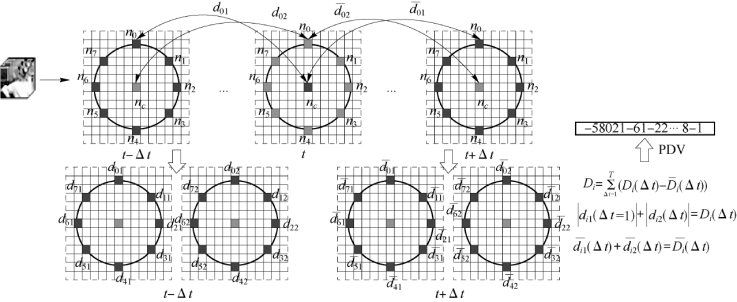

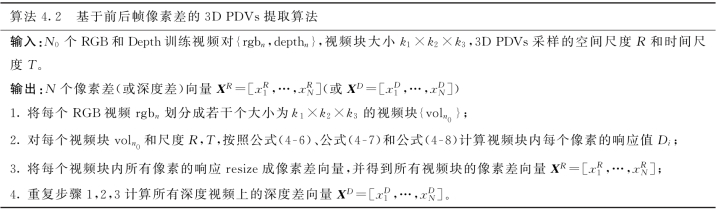

基于运动过程中像素值的变化规律,对3D LTP进行改进,提出3D像素差向量计算方法。如图4-15所示,在计算3D像素差的过程中,充分考虑不同时间上的中心像素点与相邻帧的邻域像素点的像素差值。为了研究后续RGB视频块与深度视频块的相关性,需要通过一些图像对齐技术保证RGB与深度视频在分块前在时间尺度上是一致的。在提取视频的3D像素差向量之前,需要将整个视频划分成若干个视频块{V Rijk}。对于一个给定的大小为30×30×15的RGB视频块V Rijk,具体3D像素差向量计算过程如下:

(1)取视频块中的某一帧为时间t以及若干个相邻帧[t-T,…,t-Δt,…,t+Δt,…,t+T]。当Δt=1时,对t和t-1,t+1时刻的视频帧分别取某个中心像素点nc和与其相邻的8个像素点ni,i=0,…,7。首先计算t时刻的中心点nc和t-1时刻像素点ni的像素差如下:

![]()

式中,It(nc)表示t时刻中心点nc的像素值。然后计算t时刻的像素点ni和t-1时刻中心点nc的像素差如公式(4-7)。

(4)计算视频块内所有像素点在其8个邻域点上的响应值,并将其resize成整个视频块的像素差向量。当邻域值设为1以及T=7时,该视频块的像素差向量长度为28×28×9×8。

图4-15 3D像素差计算过程

表4-5 基于前后帧像素差的3D PDVs计算流程(https://www.xing528.com)

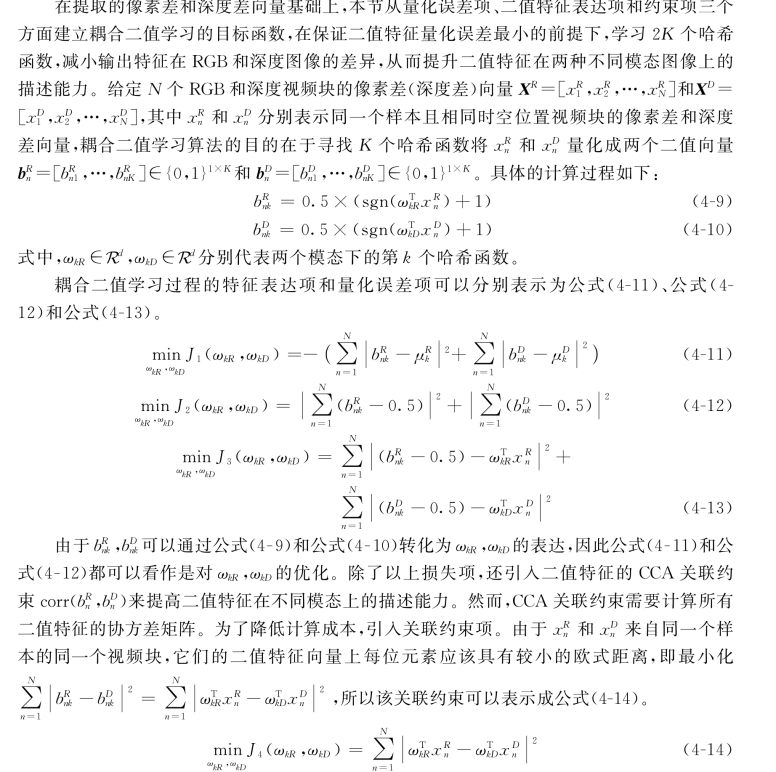

2.目标函数建立

式中,α1,α2,α3为不同损失项的平衡参数。

3.目标函数优化

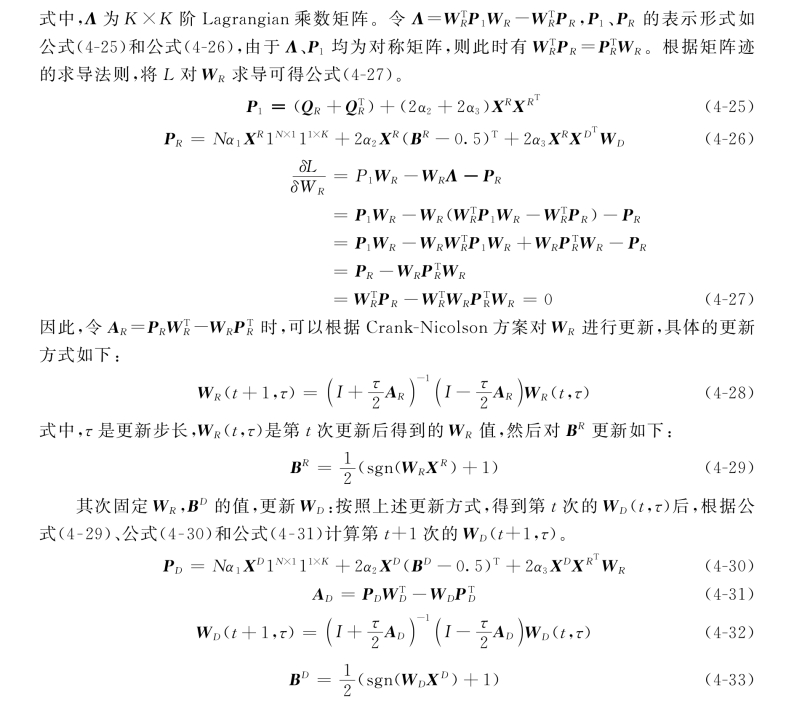

基于建立的耦合二值学习目标函数,重点描述如何对该目标函数进行优化。在公式(4-21)中,WR和WD是同时变化的,导致目标函数是非凸的。只有当其中一个变量是固定的,该目标函数才是凸的。因此,采用迭代优化的思想,固定其中一个变量,然后再求解更新另一个变量。

首先固定WD,更新WR:当WD的值固定时,公式(4-21)中的目标函数经过转化和化简后,可以表示成如下形式:

基于关联约束的耦合二值特征学习算法流程如表4-6所示。

表4-6 基于关联约束的耦合二值特征学习流程

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。