目标检测是确定图像上是否包含某类感兴趣目标并对其进行分类的过程,是很多计算机视觉任务的基础。遥感图像目标检测的研究可以追溯到20世纪80年代,随着可获取的高分辨率遥感图像数据量越来越大,图像内容越来越丰富,人们越来越关注人造目标(如飞机、舰船、网球场、建筑物等)及其场景(如机场、停车场、港口、密集建筑等)的检测和提取。相应地,对遥感图像检索任务的需求也发展到目标级。基于目标检测实现遥感图像数据的分块组织和管理更符合应用需求,成为遥感图像检索的发展趋势。特别是随着深度学习理论和技术的发展及其在目标检测领域的应用,包括R-CNN、Fast R-CNN、Faster-RCNN、YOLO和SSD等在内的经典网络结构已被成功用于实现遥感图像目标检测。

Gong Cheng等(2016)将遥感图像的目标检测方法分为4类:基于模板匹配的目标检测、基于知识的目标检测、基于对象分析的目标检测和基于机器学习的目标检测。

(1)基于模板匹配的目标检测。该类方法首先为待检测目标创建一个参照模板,然后通过滑动窗口计算图像区域与参照模板的相似度,当相似度达到某个预设距离阈值时,即认为检测到目标。这类方法在某些特定应用中具有很高的计算效率,主要局限性在于:需要有一个精确的参照模板,不满足旋转不变性和尺度不变性,对噪声也比较敏感。

(2)基于知识的目标检测方法。该类方法将目标检测问题转换为规则匹配问题。基本思路是:从图像的亮度、结构、位置关系等特征出发分析目标特性,构建目标图像的先验知识库和识别规则,从而为后续识别提供指导。主要局限性在于:如何建立准确有效的先验知识库存在不确定性,不仅需要设计者具有丰富的专业知识和经验,而且制定规则有较大主观性。

(3)基于对象分析的目标检测。基本思路是:以对象为基本处理单元,基于像素级分割,将具有相似低层视觉特征的邻近像素集视为一个对象或超像素,本质上类似于传统的基于同质区域的图像分割。主要局限性在于:采用图像区域的低层视觉特征表达图像内容存在语义鸿沟。

(4)基于机器学习的目标检测算法。基于深度学习的目标检测提供了端到端的目标检测解决方案,包含两个步骤:目标定位和目标分类。目标定位时,一般需要采用穷举或者滑动窗口的方式生成候选区域,需要耗费较高的时间成本;目标分类时,首先提取候选区域的特征,然后通过训练分类器或者神经网络的方法实现分类。目前已经提出的基于深度学习的目标检测经典网络结构包括R-CNN、Fast R-CNN、Faster-RCNN、YOLO和SSD等。

本节重点介绍基于R-CNN的目标检测算法,在此之前,首先介绍候选目标区域选择算法——选择性搜索算法(selective search,SS)。

一、候选区域选择算法

选择性搜索算法是一种代表性的候选目标区域选择算法,基本思想是:首先应用基于图理论的分割算法生成小区域,然后迭代地运行自底而上的区域合并算法,生成目标区域。与其它同类算法相比,选择性搜索算法在精度和处理速度方面均有优势。

区域合并的算法流程描述如下:

(1)首先通过基于图表示的分割算法获取原始分割区域R={r1,…,rn };

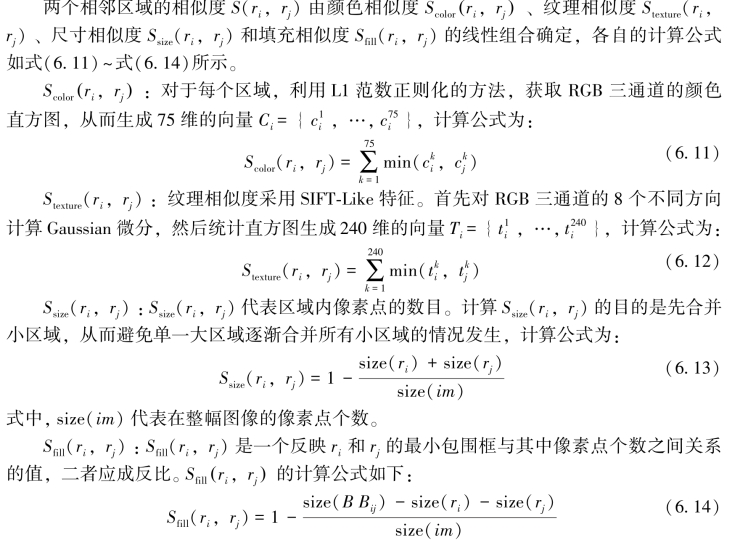

(2)设置相似度集合S=φ,然后对R中所有的相邻区域计算相似度S(ri,rj),将其添加到相似度集合S中;

(3)将S中所有区域根据S(ri,rj)排序,合并S(ri,rj)最大的两个区域ri和rj,合并后的新区域为rt。然后计算rt与相邻区域的相似度,删去S中与原先两个区域有关的相似度,更新S;

(4)迭代运行以上过程,直到S为空。

最后将以上4个相似度加权,权重值范围为0到1,得到最终的相似度S(ri,rj):

(https://www.xing528.com)

(https://www.xing528.com)

其中,ai∈(0,1),i=1,2,3,4,表示4个相似度对应的权值。

选择性搜索算法的优点可以概括为:

①多尺度特性:采用层次聚类思想满足了图像目标的多尺度特性;

②多特征融合:采用特征组合方式综合考虑了遥感图像的多种视觉特征;

③高效性:相比穷举式搜索算法,选择性搜索算法在尽量不遗漏目标的前提下,极大地降低了计算开销。

图6-18给出一组基于选择性搜索算法的目标候选区域选择效果图,并与基于均值漂移的图像分割算法结果进行了对比。可以看出,均值漂移算法存在明显的漏检现象,而选择性搜索算法提取了原始图像的大量候选区域,最大限度地确保所有目标均被检测到。

图6-18 基于选择性搜索算法的目标候选区域选择结果(与均值漂移算法对比)

需要注意的是,经过候选区域选择之后,原始图像经过被分割成若干个包含小目标的矩形区域,但是此时候选区域框存在大量重叠,需要对大量无用框进行滤除,只保留包含有效目标的候选区域框。与此同时,这些保留的候选区域框的位置信息被存储,以便在后续的检索任务中实现目标位置的正确标记。

二、基于R-CNN的目标检测算法

R-CNN算法的提出,掀起了利用深度学习技术进行目标检测研究的热潮,其算法步骤如下:

(1)对于输入图像,利用候选目标区域选择算法提取可能包含目标的候选区域;

(2)将每个提取的候选区域的尺寸调整为224×224像素,输入到卷积神经网络中提取视觉特征;

(3)训练一个分类器,对提取到的深度特征进行分类。

后来提出的Fast-RCNN和Faster-RCNN是在R-CNN基础上的改进。由于选择性搜索算法提取的候选区域是图像的一部分,很多时候存在重叠,对每个候选区域都提取深度特征会造成大量重复计算。Fast-RCNN针对这一问题做了改进,将整幅图像输入神经网络提取一次特征,然后将候选区域的位置映射到特征图上,大大降低了计算开销。同时,Fast-RCNN直接利用Softmax代替了SVM进行分类。

Faster-RCNN算法的改进之处在于训练了一个区域生成网络(region proposal network,RPN)来替代选择性搜索算法,直接将整幅图像输入到卷积神经网络中,在最后一个卷积层后面加上RPN网络,直接生成候选区域,然后根据得到的深度特征进行分类。

检测到的所有目标构成候选的目标数据集,检索时返回与用户输入的查询目标特征相似的集合作为检索结果。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。